Por Jim Vorel

¿Qué debe hacer exactamente un periodista cuando la empresa de medios para la que trabaja fomenta o exige la incorporación cada vez mayor de herramientas de inteligencia artificial en sus escritos, pero esas mismas herramientas, además de socavar inherentemente la necesidad del empleado en cuestión, siguen sin ser confiables para no inventar información? En otras palabras, ¿quién debe rendir cuentas cuando el contenido producido por IA resulta ser defectuoso, incorrecto o estar lleno de mentiras? ¿Se rinden los directivos? ¿O es el escritor quien, en última instancia, tiene más probabilidades de ser sacrificado al ser traicionado por las herramientas de IA que se le ha obligado a utilizar?

Vimos algo similar esta semana, aunque como en la mayoría de este tipo de historias, la culpa claramente recae en múltiples partes, y los problemas no son nada claros. Un reportero de Ars Technica , cuyo tema era informar específicamente sobre IA, fue despedido después de que se revelara que un artículo del que había sido coautor contenía citas inventadas por las herramientas de IA que estaba usando. Ars Technica se ha retractado posteriormente de la historia original por completo, publicando una nota del editor, afirmando que fue «una falla grave de nuestros estándares», pero que creen que es un «incidente aislado». Cabe destacar que no se mencionó ninguna pérdida de empleos ni disciplina del liderazgo editorial de la publicación de Condé Nast, solo el reportero que fue coautor del artículo, quien se puso manos a la obra y asumió toda la responsabilidad.

El escritor en cuestión es Benj Edwards, quien hasta hace poco ostentaba el título de «reportero senior de IA» de Ars Technica . El artículo era una reseña de un incidente viral reciente de febrero, en el que un codificador/programador llamado Scott Shambaugh detalló en una entrada de blog cómo un programa de IA lo había amenazado esencialmente para que Shambaugh favoreciera el código que había escrito. En su propio mea culpa, Edwards explicó cómo había escrito la historia desde su casa en su cama de enfermo, recuperándose de COVID-19, mientras usaba IA «no para generar el artículo, sino para ayudar a listar referencias estructuradas que pudiera poner en mi esquema». Al hacerlo, terminó usando citas parafraseadas ideadas por el chatbot, en lugar de las citas reales de Shambaugh, algo que tanto Edwards como sus editores no notaron ni verificaron en sus revisiones. Fue Shambaugh, de hecho, quien señaló que las citas no le pertenecían.

Un par de cosas aquí: Este es uno de esos incidentes en los que podemos sentir simultáneamente juicio y empatía. Edwards admite su culpa y señala que estaba «enfermo y con prisas por terminar» mientras hacía el trabajo, invocando nuestra rutina capitalista diaria, en la que se espera que incluso una persona con fiebre y postrada en cama, enferma del virus que mató a más de un millón de estadounidenses, siga produciendo contenido para la fábrica. ¿Quién de nosotros no ha sido negligente en algún momento, al hacer algo como trabajar estando enfermo e intentar ser un jugador de equipo? Pero al mismo tiempo, también es innegable que Edwards debería haberlo pensado mejor, sobre todo como reportero especializado en IA. Estos son los peligros que conlleva el uso de sistemas que son a la vez geniales y exasperantemente estúpidos, e inherentemente impredecibles. Alguien como Edwards, que sabe exactamente lo que la IA es capaz de hacer cuando se aleja de la realidad y abraza la fantasía, debería haber sido extremadamente cauteloso al verificar cada posible aplicación de la misma… o haber sabido lo suficiente como para no usarla para ningún propósito en el que pudiera generar información falsa en primer lugar.

Pero ¿qué pasa con los escritores y reporteros que no se autoproclaman expertos en IA? Si incluso un reportero experto termina siendo engañado por la fe en esta tecnología y publica falsedades, ¿cómo utilizarán la IA aquellos escritores que no se dan cuenta de la magnitud de sus posibles fallos y artimañas? Cuando los jefes dicen que parte de tu trabajo como reportero es usar IA y lo exigen, ¿qué posibilidades de inexactitud sistémica se están introduciendo en el proceso? ¿Hay algún beneficio para el escritor (suponiendo que aún tenga trabajo) al final del día, cuando la herramienta que te ahorra tiempo te obliga a verificar a fondo todo lo que toca? Si una agencia de empleo temporal te enviara un empleado, pero te dijera: «Oye, este tipo es muy trabajador, pero también miente el 1% del tiempo, así que tendrás que comprobarlo», ¿te entusiasmaría contratar sus servicios?

Cada vez más, los periodistas se dan cuenta de que realmente no tienen otra opción. A mediados de febrero, la atención se centró en el diario de Cleveland, The Plain Dealer (propiedad de Advance Publications), con 184 años de antigüedad, cuando el editor Chris Quinn publicó una columna en la que se quejaba de que un recién graduado universitario había renunciado a una beca de periodismo al enterarse de que el trabajo no implicaría escribir, sino que estaría introduciendo notas en una herramienta de inteligencia artificial que produciría historias. Quinn enmarcó la decisión de este graduado en periodismo de rechazar el puesto como la de un idealista que se queda atrás del progreso, alguien que ignora todos los beneficios que la inteligencia artificial proporciona a las operaciones de recopilación de noticias. Y, de hecho, seguramente hay innumerables maneras en que las herramientas de inteligencia artificial podrían utilizarse para facilitar el proceso de llegar al botón de «publicar». Pero muchos en el mundo de los medios aún ponen un límite cuando se trata de utilizar la inteligencia artificial para generar artículos completos, eliminando por completo a los humanos del proceso de escritura. La opinión de Quinn, por su parte, no podía dejar de sonar corporativista y vagamente distópica en líneas como las siguientes:

“La inteligencia artificial no es mala para las redacciones. Es su futuro”, escribió. “Al eliminar la redacción de la carga de trabajo de los reporteros, les hemos liberado un día de trabajo extra cada semana”.

Se puede comprender la aplastante realidad económica de intentar hacer viable un negocio/vida en un mundo editorial en el que las ganancias prácticamente han desaparecido, como señala Quinn, que la sala de redacción de The Plain Dealer se ha reducido de unos 400 empleados a finales de los 90 a solo 71 en la actualidad, y un diario de 240 años como el Pittsburgh Post-Gazette cierra sus puertas. Pero una cita como «efectivamente les hemos liberado un día de trabajo extra cada semana» no puede evitar estremecerse por la forma en que implica el despojo de cualquier atisbo de la identidad de un escritor más allá de las palabras en la página, y la sin duda mayor cuota de «contenido» que se espera que el escritor genere con las ingeniosas nuevas herramientas a su disposición. Es bueno que personas como Studs Terkel no vivieran para ver su profesión sufrir este tipo de degradación impulsada por la tecnología.

Quizás lo más preocupante, sin embargo, no es la idea de que se emplee IA para escribir artículos completos, que el lector (asumiendo que sabe que es IA, lo cual es un gran «si») puede simplemente elegir ignorar. Es la idea de que los reporteros y escritores deberían utilizar intensamente la IA para acelerar y agilizar el trabajo que aún lleva su firma, y la realidad tácita de que se supone que el escritor todavía debe respaldar y ser culpable del trabajo que lleva la marca de la influencia de la IA. Según empleados anónimos de The Plain Dealer que hablaron con The Washington Post , el periódico en 2025 comenzó a pagar por el acceso completo a ChaptGPT, con su editor Quinn alentando el «uso sin restricciones» de la herramienta, algo que él niega. Sin embargo, el personal ha dicho que las historias publicadas por el periódico que involucran el uso de IA tienen «barandillas mínimas a pesar de las afirmaciones de que están completamente editadas y verificadas». Otro miembro del personal se quejó de que los criterios sobre cuánto se supone que deben emplear la IA siguen cambiando, y que había recibido evaluaciones anuales de desempeño que indicaban un «uso insuficiente de la IA» en comparación con sus compañeros. ¿Acaso el mismo jefe que te exige que involucres más a ChatGPT en tus reportajes asumirá las consecuencias si la IA introduce errores perjudiciales en tu trabajo? Por cierto: solo el 16 % de los periodistas estadounidenses están afiliados a un sindicato, lo que significa que muchos no cuentan con una organización dedicada a representar sus intereses en este tipo de situación que pone en peligro su carrera.

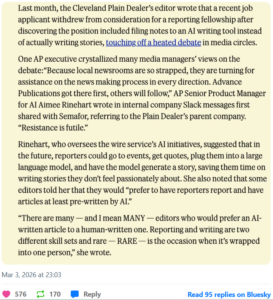

Y, sin embargo, quienes toman las decisiones no muestran una preocupación real ni por los temores existenciales de los escritores ni por la responsabilidad que la IA puede representarles. Según mensajes internos de Slack de Associated Press compartidos con Semafor, uno de los expertos en IA de la organización afirmó que «la resistencia es inútil» ante las objeciones de los periodistas, a la vez que denigraba las habilidades de los empleados de la empresa al afirmar que la mayoría no tiene el talento suficiente para informar y escribir.

“Debido a la escasez de recursos que enfrentan las redacciones locales, buscan ayuda en todos los ámbitos para la elaboración de noticias. Advance Publications llegó primero, y otras seguirán”, escribió Aimee Rinehart, gerente sénior de producto de AP para IA, en un mensaje de Slack. “Muchos editores —y me refiero a MUCHOS— preferirían un artículo escrito por IA a uno escrito por humanos. Reportar y escribir son dos habilidades diferentes, y raras —rarísimas— son las ocasiones en que una sola persona las reúne”.

Eso es… ¡guau! Pocas veces se ve a alguien en la industria periodística proclamar con tanto entusiasmo que los escritores, que son el alma de la industria, son una panda de ineptos sin talento que sería mejor reemplazar por robots. Es una cita tan mala que la AP se desentendió diplomáticamente en su propia declaración a Semafor, pero hay que asumir que la postura interna filtrada probablemente suene más cierta que el pulido comunicado de prensa:

“Esta discusión interna entre el personal de diferentes departamentos no refleja la postura general de AP respecto al uso de IA”, declaró AP. “Hemos sido líderes en la industria al establecer estándares de IA que protegen el rol vital de los periodistas, a la vez que permiten su uso para tareas como traducción, resúmenes, transcripciones y etiquetado de contenido”.

Pero los «estándares» y las «salvaguardias» siguen fallando todo el tiempo, cuando se trata de imprecisiones masivas introducidas en el contenido publicado por IA. En mayo, tanto el Chicago Sun-Times como el Philadelphia Inquirer se vieron obligados a disculparse después de publicar, nada menos, contenido sindicado con toneladas de material alucinado por IA, como una «lista de lectura de verano» compilada por un freelancer a través de IA que estaba llena de libros falsos y autores falsos. Ese autor afirmó que la lista era un error, pero también hemos visto a verdaderos malos actores aprovechándose de la falta de vigilancia por parte de los editores para ofrecer contenido freelance generado por IA a cualquiera que lo compre. Este otoño, Business Insider y Wired terminaron retractándose de casi 40 ensayos de una variedad de autores freelance que podrían haber sido la misma persona, usando una variedad de seudónimos para vender historias generadas por IA.

“Los avances en inteligencia artificial permiten desarrollar ataques insidiosos y altamente peligrosos a bajo costo”, declaró Vincent Berthier, de la organización sin fines de lucro Reporteros Sin Fronteras, al Washington Post en aquel momento. “Ya se trate de periodistas falsos, medios de comunicación fraudulentos o deepfakes, los ataques a la credibilidad de los medios son cada vez más evidentes”.

Y esa es la cuestión, al final: la intrusión de la IA en el mundo del periodismo tradicional y la escritura digital ha seguido erosionando tanto la percepción pública del valor que poseen estos campos como la confianza del público en todo lo que leen. Se está obligando a los periodistas a llenar su trabajo con elementos de IA en nombre de una mayor eficiencia, pero a costa de degradar la opinión pública sobre los mismos textos que producen. Y cuando la IA falla, como suele ocurrir, de repente la responsabilidad por «su propio trabajo» regresa de golpe.

JEZEBEL